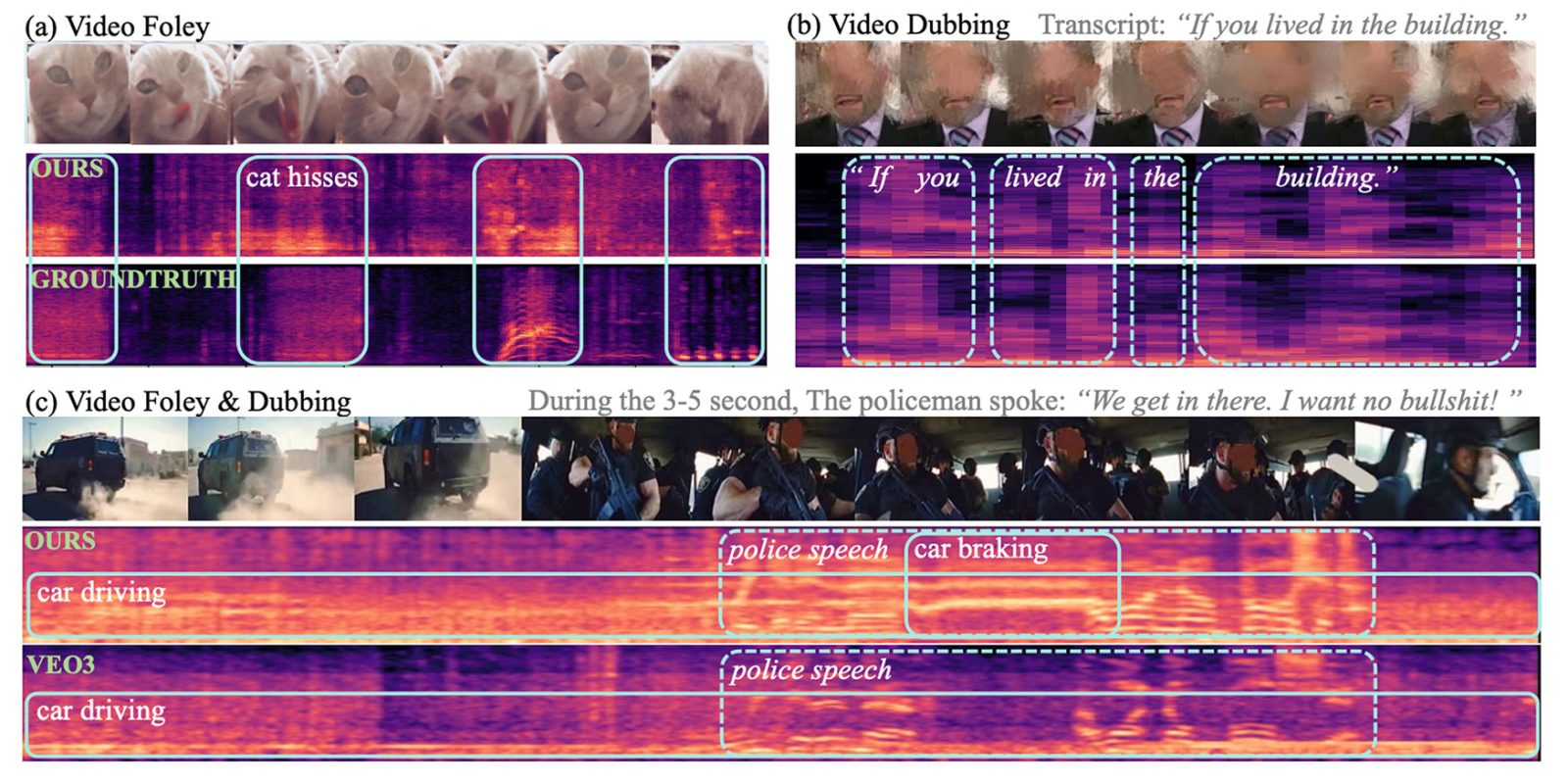

アップルと中国人民大学の研究者たちは、新しいAIモデル「VSSFlow」を開発し、無音動画から音声と効果音を生成することが可能だと発表しました。このモデルは、音声と効果音を統合したシステムで生成できることが特徴です。従来のモデルは、音声生成と効果音生成を別々に行うことが一般的でしたが、VSSFlowはこれらを統合し、相互に学習を向上させる仕組みを持っています。

VSSFlowは、生成AIの複数の概念を活用し、トランスクリプトを音素のトークン列に変換し、ノイズから音を再構築するフローマッチングを学習します。このプロセスは、ランダムなノイズから目的の信号を効率的に生成するようにモデルを訓練します。

研究者たちは、VSSFlowをトレーニングするために、無音動画と環境音(V2S)、無音の会話動画とトランスクリプト(VisualTTS)、そしてテキスト音声データ(TTS)を組み合わせて使用しました。これにより、音声と効果音をエンドツーエンドで学習することができました。

VSSFlowは、無音動画から音声と音を生成する際、動画から毎秒10フレームの視覚的手がかりを使用して環境音を形成し、同時にトランスクリプトが生成される音声に正確なガイダンスを提供します。このプロセスにより、音声と効果音の両方が単一のシステムで処理されます。

研究者たちは、VSSFlowのコードをGitHubでオープンソース化し、モデルの重みも公開する予定です。また、推論デモの提供にも取り組んでいるということです。

今後の研究について、研究者たちは、ビデオ・音声・音のデータの不足が統合生成モデルの開発を制限していると指摘し、音声と効果音の詳細を保持しつつコンパクトな表現方法の開発が重要な課題であるとしています。