グーグルは、Androidプラットフォームにおいて「AppFunctions」と呼ばれる新しい機能を発表し、ジェミニがアプリケーションを利用できるようにする方針を明らかにしました。この機能は、アプリとエージェントアプリやパーソナライズされたアシスタントとの間のギャップを埋める初期段階の開発者向け機能を提供するということです。

グーグルは、プライバシーとセキュリティを核心に据えた設計を行い、アプリエコシステムにおけるパラダイムシフトを探求する第一歩としています。

「AppFunctions」はAndroid 16プラットフォームの一部であり、Jetpackライブラリと共に、エージェントアプリがデバイス上で特定の機能にアクセスし、実行できるようにするということです。開発者は自分のアプリの機能を、エージェントやAIアシスタント(ジェミニなど)が利用できるツールとして詳細に記述します。

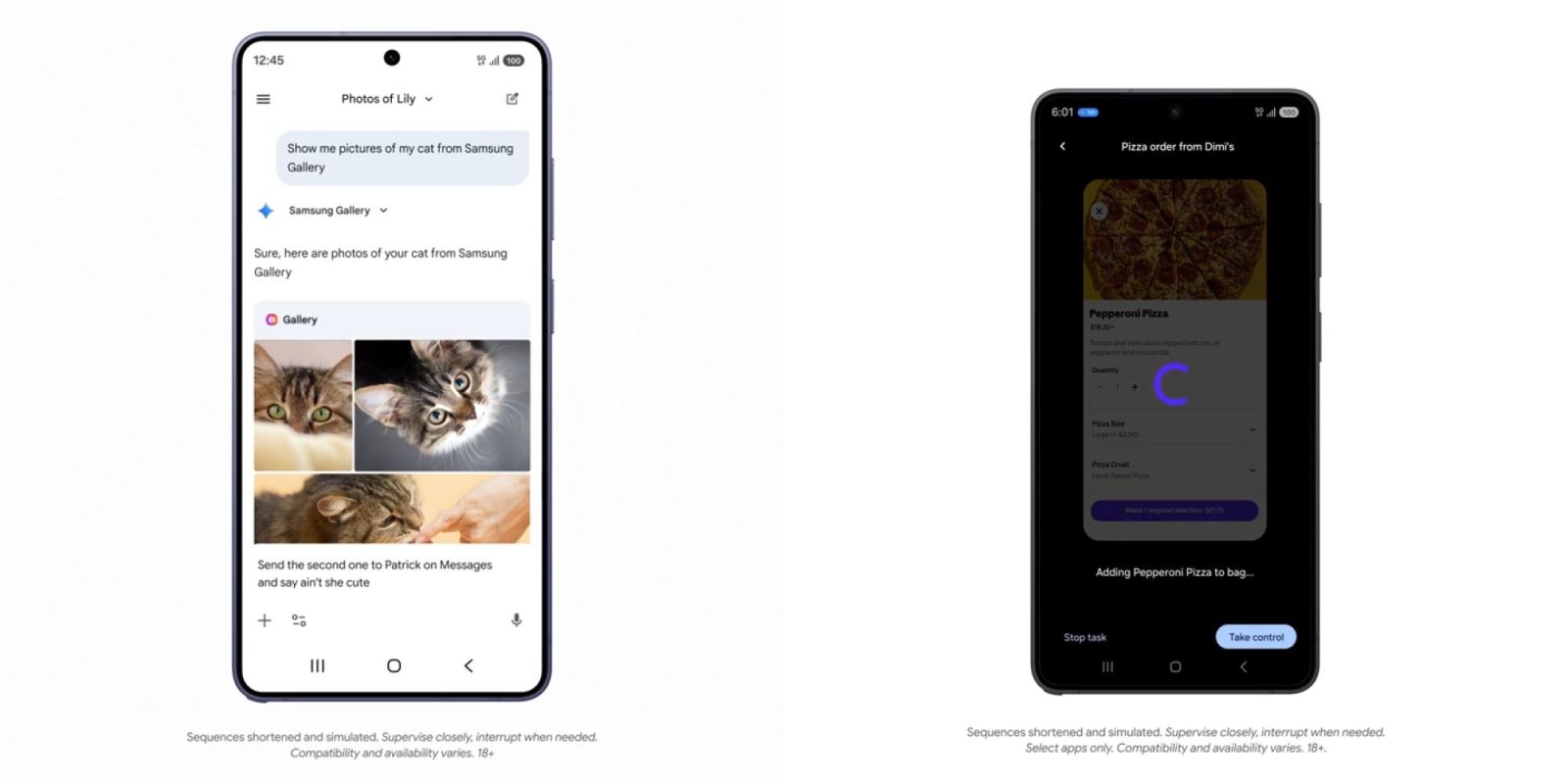

たとえば、サムスンのギャラリーアプリを利用した「AppFunctions」の例として、ユーザーが「サムスンギャラリーの猫の写真を見せて」とジェミニに指示すると、ジェミニは適切な機能を特定して実行し、ギャラリーから直接写真を表示することが可能です。この体験はマルチモーダルであり、音声やテキストで行うことができます。

一方、グーグルはジェミニアプリがすでにカレンダー、ノート、タスクの統合に「AppFunctions」を利用しているとしています。

また、グーグルは「UIオートメーションフレームワーク」を開発中で、AIエージェントやアシスタントがユーザーのインストールしたアプリで汎用的なタスクをインテリジェントに実行できるようにする方針です。これは開発者がコードを書かずにエージェントの到達範囲を拡大するための低労力な方法です。

グーグルは、Android 17でこれらの機能をさらに多くのユーザー、開発者、デバイスメーカーに提供する計画を発表しました。現在、少数のアプリ開発者と協力し、高品質なユーザー体験を構築しているということです。詳細は今年後半に発表する予定です。