マイクロソフトは今週、自社開発のAIチップ「Maia 200」を初めてデータセンターに導入し、今後数ヶ月でさらに展開する計画であると発表しました。

このチップは「AI推論の強力装置」として設計されており、AIモデルのプロダクションでの運用に最適化されています。マイクロソフトは、Amazonの最新のTrainiumチップやGoogleの最新のTensor Processing Units(TPU)を上回る処理速度を持つとしています。

クラウド大手各社は、自社のAIチップ設計に取り組んでいますが、これはNvidiaの最新チップを入手するのが難しく、費用がかかるためです。この供給不足は解消の兆しを見せていません。

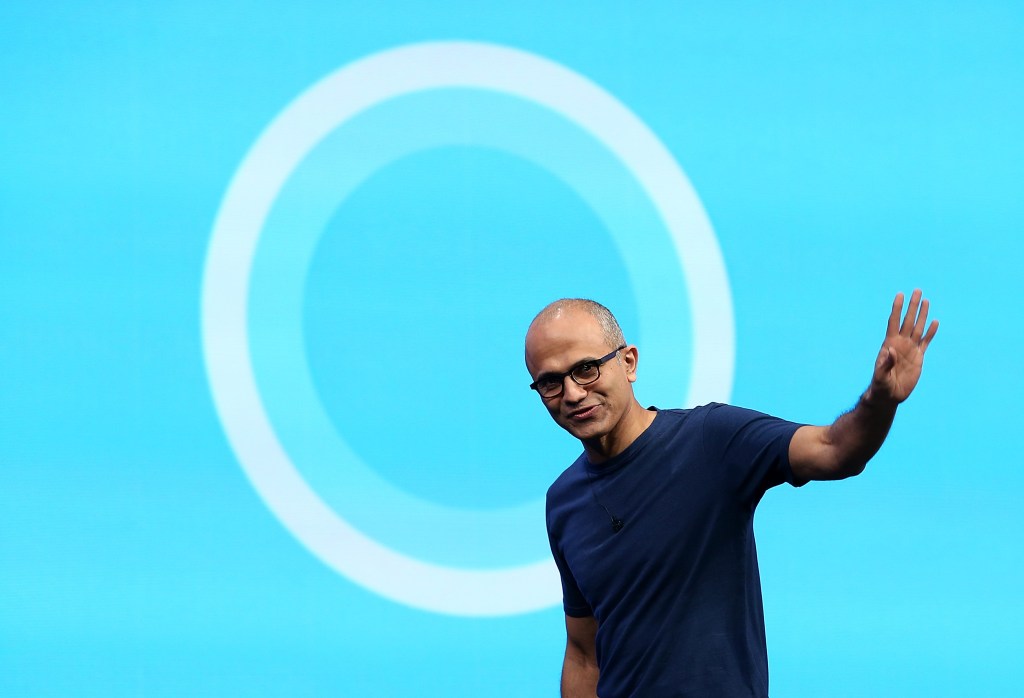

しかし、最先端の高性能チップを自社で持ちながらも、マイクロソフトのサティア・ナデラCEOは他社製チップの購入を継続する方針です。「NvidiaやAMDとの素晴らしいパートナーシップがあります。彼らも革新し、我々も革新しています」と述べました。「誰が先を行くかを語る人は多いですが、常に先を行く必要があることを忘れないでください」とも述べています。

さらに、「垂直統合が可能だからといって、それだけに依存するわけではない」とも語り、他社製品を使用せずに自社でシステムを構築することを意味します。

なお、Maia 200は、マイクロソフトの「Superintelligence」チームによって使用される予定であるということです。このチームは、ソフトウェア大手の自社フロンティアモデルを開発するAI専門家で構成されています。マイクロソフトは、将来的にOpenAIやAnthropicなどのモデルメーカーへの依存を軽減することを目指しています。

Maia 200チップは、マイクロソフトのAzureクラウドプラットフォーム上で稼働するOpenAIのモデルもサポートする予定です。しかし、最先端のAIハードウェアへのアクセスを確保することは、顧客や内部チームにとって依然として課題であるということです。

そのため、Mustafa Suleyman氏はXに投稿し、このニュースを喜んで共有しました。「今日は大きな日です」とチップの発売時に書き込み、「我々のSuperintelligenceチームがMaia 200を最初に使用し、フロンティアAIモデルを開発します」と述べました。